Юваль Харари: системная ошибка «Homo Deus»

Настоящий исследовательский отчет представляет собой исчерпывающий системный анализ и фактологический аудит концептуальных моделей Юваля Ноя Харари, изложенных в его трудах «Homo Deus: Краткая история завтрашнего дня» и «21 урок для XXI века». Основная цель данного аудита заключается в сборе и структурировании доказательной базы, подтверждающей следующий инженерный и кибернетический постулат: прямая аппаратная и биологическая интеграция человеческого организма с системами искусственного интеллекта (ИИ) без предварительного качественного обновления когнитивного «программного обеспечения» (управляемой эволюции феноменального сознания) математически и структурно неизбежно ведет к формированию тотального алгоритмического контроля, концептуализируемого как «цифровой концентрационный лагерь».

Анализ проводится в рамках строгой методологии системной инженерии, исключающей этические, философские и эмоциональные абстракции. В качестве аналитического инструментария применяются законы кибернетики, когнитивных наук, квантовой нейробиологии и теории сложных систем.

Извлечение исходного кода Харари (Анализ базовой архитектуры «Homo Deus»)

Для проведения корректной диагностики уязвимостей необходимо осуществить точную экстракцию базовых постулатов, на которых Юваль Ной Харари строит свою прогностическую модель социо-технологического будущего. Архитектура его концепции опирается на строгий биологический редукционизм, в рамках которого субъектность человека полностью деконструируется.

Концепция человека как «Биохимического алгоритма»

Фундаментальный тезис Харари, формирующий ядро его системной модели, заключается в сведении всех ментальных, эмоциональных и когнитивных процессов человека к вычислительным операциям конечного автомата. Данный подход отрицает наличие феноменального сознания как независимого фактора и классифицирует человеческие чувства не как отражение духовной природы или проявление свободной воли, а как сугубо эволюционные вычислительные инструменты. Харари прямо утверждает, что научные данные свидетельствуют о том, что чувства представляют собой биохимические механизмы, которые все млекопитающие и птицы используют для быстрого вычисления вероятностей выживания и размножения.1 В этой парадигме любые когнитивные реакции основаны не на интуиции, вдохновении или свободе, а исключительно на математическом расчете.1

Следствием данного подхода является восприятие биологического организма как программного кода. Харари предлагает рассматривать живые организмы как «не более чем биохимические алгоритмы». Он сводит высшую нервную деятельность к автоматическим, детерминированным процессам, заявляя, что ментальные ощущения, если рассматривать их через призму буддийских практик в его интерпретации, являются лишь «эфемерными и бессмысленными вибрациями».4 Любое устойчивое представление о наличии некоего истинного, неделимого «Я» (субъектности) классифицируется в архитектуре «Homo Deus» как «утешительная фикция». В реальности, согласно данной модели, человек представляет собой лишь постоянно меняющуюся сеть нейронов, решения которой, кажущиеся свободно выбранными, на самом деле являются результатом работы этих биохимических алгоритмов.

1.2. Архитектура «Бесполезного класса» (The Useless Class)

На базе постулата об алгоритмической и детерминированной природе человека Харари логически выводит неизбежность масштабного системного сбоя на уровне глобальной экономики и социума. Этим сбоем становится формирование так называемого «бесполезного класса». Данная концепция строится на анализе производительности систем. Харари отмечает, что человек обладает лишь двумя типами базовых навыков: физическими и когнитивными. Поскольку искусственные интеллектуальные системы в силу своей неорганической природы и скорости вычислений начинают превосходить человека в обеих категориях, алгоритмы неизбежно вытеснят людей из большинства производственных, аналитических и даже творческих процессов.

В рамках исторического системного анализа Харари указывает на радикальный сдвиг. В индустриальную эпоху государственные механизмы инвестировали в здоровье, образование и благополучие масс, поскольку система нуждалась в миллионах здоровых рабочих для функционирования фабрик и миллионах лояльных солдат для ведения войн. В постиндустриальную эпоху армии начинают опираться на автономные дроны, кибер-системы и небольшое количество профессионалов, делая массы «военно бесполезными». В гражданской экономике происходит аналогичный процесс. Таким образом, глобальная система переходит от модели эксплуатации к модели тотальной нерелевантности. Харари предупреждает, что будущие социальные потрясения будут направлены не против элиты, которая эксплуатирует людей, а против элиты, которая в них больше не нуждается. Массы столкнутся с абсолютной потерей своей системной функции, что приведет к тому, что миллиарды людей станут определяться политической и экономической системой как «бесполезные».

Данный процесс неизбежно приведет к беспрецедентной концентрации системного управления. Харари приводит пример транспортной отрасли: если сегодня миллионы водителей обладают долей рыночной власти и способны объединяться в профсоюзы, то в будущем, когда транспорт будет контролироваться единым автономным алгоритмом, принадлежащим нескольким корпорациям, вся экономическая и политическая власть консолидируется в руках микроскопической элиты. Государство потеряет любой экономический стимул поддерживать благополучие масс, что в условиях кризисов может привести к тому, что элиты предпочтут инвестировать в биологический апгрейд самих себя, полностью отбросив избыточную популяцию.

1.3. Датаизм (Dataism) как новая целевая функция эволюции

Логическим завершением редукционистской модели Харари является постулирование возникновения новой онтологии и глобальной архитектуры управления, которую он называет «Датаизмом». Данная парадигма переопределяет саму физическую реальность. В системе координат Датаизма вся Вселенная, включая фундаментальную физику, биологию и макроэкономику, воспринимается исключительно как поток данных. Органические существа, включая человека, рассматриваются лишь как примитивные вычислительные элементы, способные интерпретировать лишь малую долю этой реальности.6

Центральным аспектом Датаизма является смена источника системного авторитета. Если исторически авторитет исходил от богов или человеческого гуманизма (чувств), то в XXI веке авторитет передается от людей к алгоритмам и системам обработки данных. Человечество стремительно превращается в набор «крошечных чипов внутри гигантской системы обработки данных, которую никто по-настоящему не понимает». Метрика ценности любой сущности в этой новой операционной среде определяется исключительно ее пропускной способностью — умением эффективно обрабатывать информацию. Конечной космической задачей человечества провозглашается создание всеобъемлющей, тотальной системы обработки данных с последующим полным слиянием и растворением в ней. В этой системе владение данными определяет будущее, порождая критический вопрос о том, кому принадлежат биометрические и нейрофизиологические данные человека — корпорациям, государству или самому алгоритму.

Характеристика системы | Гуманистическая парадигма (прошлое) | Парадигма Датаизма по Харари (будущее) |

|---|---|---|

Источник авторитета | Субъективные чувства человека, свободная воля | Массивы больших данных (Big Data), алгоритмы машинного обучения |

Онтология реальности | Физические и духовные феномены | Исключительно потоки данных |

Определение человека | Независимый субъект, носитель уникального смысла | Биохимический алгоритм, узел обработки информации |

Метрика ценности | Способность к переживанию, этика | Пропускная способность и эффективность обработки данных |

Экономический статус масс | Базовый ресурс системы (рабочие, солдаты) | Избыточный и структурно «бесполезный класс» |

Целевая функция | Обеспечение блага и процветания человека | Создание всеобъемлющей сети обработки данных |

Блок 2: Диагностика системного сбоя и уязвимостей концепции Харари

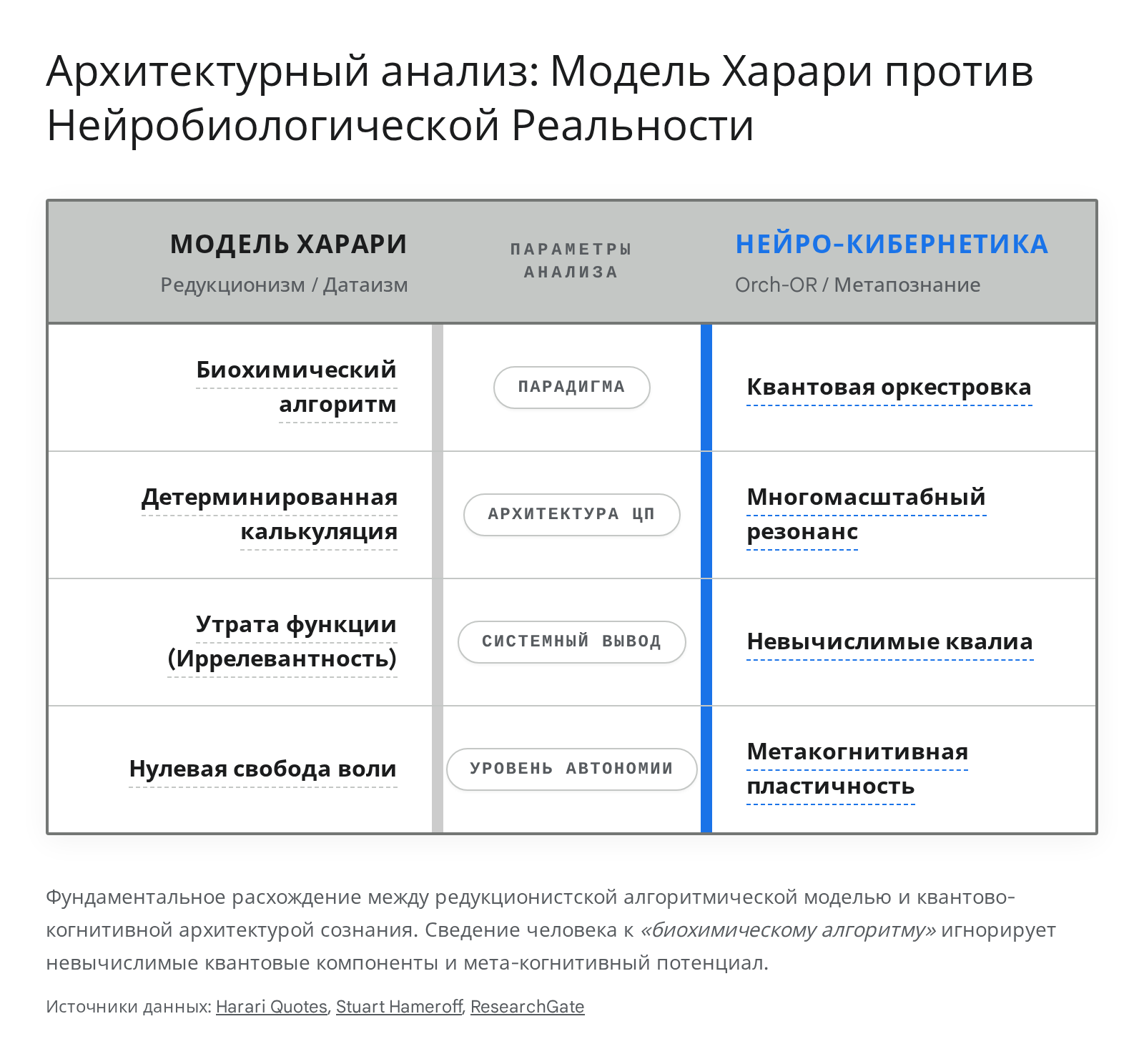

Модель Харари обладает критической архитектурной уязвимостью, делающей ее непригодной для масштабирования. Она строится на ложной эквивалентности алгоритмического распознавания паттернов машинами и феноменального сознания биологических субъектов. Проведение системной диагностики требует детального обращения к актуальным данным когнитивных наук, нейробиологии и квантовой физики, которые математически и физически опровергают сведение человека к примитивному биохимическому автомату.

2.1. Критика алгоритмического детерминизма и невычислимая природа Квалиа

Фундаментальная ошибка Датаизма заключается в игнорировании предела Тьюринга применительно к человеческой субъектности и феноменальному сознанию. Современные системы искусственного интеллекта, включая самые продвинутые глубокие нейронные сети и модели мета-обучения, концептуально и аппаратно оперируют на базе архитектуры фон Неймана, которая по своей математической сути является сложной реализацией машины Тьюринга. Вычислительный интеллект таких систем сводится к последовательному выполнению инструкций, сложному распознаванию паттернов и вычислению многомерных вероятностных распределений.

Системным опровержением редукционистской модели Харари служит тот доказанный факт, что структурное вычисление (computation) не тождественно семантическому пониманию (understanding). Истинное понимание окружающей среды и смыслов требует обязательного наличия квалиа (qualia) — субъективных качественных характеристик сознательного опыта. Примерами квалиа являются субъективное, феноменальное восприятие насыщенности красного цвета, физиологическое ощущение боли или тональность звука. Эти субъективные аспекты имеют строго нефизическую с точки зрения классической механики и абсолютно невычислимую природу, поскольку они сопротивляются редукции к набору бинарных физических инструкций.

Феноменальное сознание, выступающее генератором квалиа, представляет собой специфический биологический процесс. Поскольку машины лишены биологических нейронных коррелятов сознания, они не могут обладать квалиа и, следовательно, не способны к истинному пониманию; они осуществляют лишь сверхсложную корреляцию входных и выходных сигналов на основе поиска совпадений в данных. В системном анализе постулируется, что степень вычислительного интеллекта (способность алгоритма решать задачи) является величиной, полностью независимой от переменной феноменального сознания. Более того, на основе второй теоремы Гёделя о неполноте доказывается, что человеческий интеллект способен концептуализировать истины и решать задачи, которые принципиально не могут быть выведены ни одной формальной алгоритмической системой. Утверждение Харари о том, что люди — это просто устаревшие биохимические алгоритмы, технологически, математически и биологически несостоятельно, так как оно игнорирует невычислимые компоненты психики.

2.2. Квантово-кибернетические модели сознания (Orch-OR)

Научный консенсус в области теоретической физики и нейробиологии предоставляет строгую аппаратную дифференциацию между машинным программным кодом и биологическим человеческим сознанием. В первую очередь это реализуется посредством теории оркестрованной объективной редукции (Orch-OR). Данная теория, разработанная в середине 1990-х годов выдающимся британским физиком-математиком сэром Роджером Пенроузом (Sir Roger Penrose) и американским исследователем-анестезиологом Стюартом Хамероффом (Stuart Hameroff), постулирует, что феноменальное сознание генерируется на квантовом уровне глубоко внутри нейронов.

Теория Orch-OR отвергает классическую нейробиологическую парадигму, в которой мозг рассматривается просто как биологический компьютер, где нейроны выступают аналогами транзисторов. Вместо этого Orch-OR определяет иной аппаратный субстрат сознания: базовым квантовым узлом обработки информации являются микротрубочки (microtubules) — цилиндрические белковые полимеры, образующие цитоскелет внутри цитоплазмы нейронов. Согласно этой архитектуре, сознание не эмерджирует из классических вычислений, а является результатом квантовых вибраций, происходящих в этих полимерах. Диполи в спиральных путях микротрубочек формируют резонансные кольца суперпозиции.

Процесс обработки информации происходит, когда эти квантовые состояния интерферируют и затем спонтанно «коллапсируют» в классическое состояние. Этот процесс называется «объективной редукцией» (objective reduction) и управляется объективным порогом, связанным с разницей кривизны пространства-времени на планковском масштабе. Закон, управляющий этим коллапсом, не является ни случайным, ни алгоритмически детерминированным; он является детерминированным, но невычислимым. Это обеспечивает физическое решение проблемы перехода от квантового мира к классическому, которое невозможно смоделировать с помощью алгоритмов, использующих конечное число шагов. Современные экспериментальные данные, включая фармакологические исследования, подтверждают эту модель, демонстрируя, что анестетики отключают человеческое сознание именно путем блокировки квантовых каналов внутри микротрубочек, которые имеют многоуровневые резонансы в мегагерцовом диапазоне.

2.3. Мета-когнитивный контроль как неучтенный фактор системы

Вторая фундаментальная системная ошибка концепции Харари заключается в полном игнорировании эволюции самого сознания и мета-когнитивного потенциала биологического оператора. Харари принимает базовые, автоматические реакции лимбической системы (первичные животные инстинкты, стрессовые реакции, влечения) за неизменную, жестко закодированную константу. Однако современная когнитивная кибернетика и нейробиология выделяют феномен мета-познания (meta-cognition) — способности высокоразвитой системы осознавать собственное осознание и осуществлять контроль над внутренними рекурсивными состояниями.

В то время как классические детерминированные алгоритмы (искусственные или базовые нейрофизиологические паттерны) работают строго линейно по принципу «стимул-реакция», мета-познание создает сложную петлю рекурсивной обратной связи. Это формирует самореферентную когнитивную архитектуру, способную не только отслеживать, но и сознательно модифицировать, анализировать и перепрограммировать саму себя в режиме реального времени. Мозг человека повсеместно использует механизмы мета-обучения (meta-learning), что позволяет ему динамически регулировать собственные биохимические процессы. Например, через сложную регуляцию взаимодействия серотонина и дофамина в префронтальной коре и базальных ганглиях мозг способен изменять собственные «гиперпараметры» и адаптироваться к новым задачам без необходимости «обучения с нуля», в чем ИИ до сих пор критически уступает биологическим системам.

Параметр сравнения | Вычислительный алгоритм (ИИ) | Нейробиологическое мета-сознание |

|---|---|---|

Базовая архитектура | Фон Неймана (Машина Тьюринга) | Квантово-биологическая (Оркестрованная редукция) |

Природа обработки | Детерминированная или стохастическая, строго вычислимая | Детерминированная, но принципиально невычислимая |

Наличие Квалиа | Отсутствует (имитация понимания) | Присутствует (субъективный феноменальный опыт) |

Адаптивность (Meta-learning) | Требует внешнего изменения весов или масштабного переобучения | Внутренняя рекурсивная корректировка (префронтальная кора) |

Степень детерминизма | Жестко задана начальным кодом и тренировочными данными | Пластична, способна к волевому перепрограммированию реакций |

Сводя сложнейшую биологическую систему исключительно к набору автоматических триггеров и алгоритмов выживания, Харари описывает лишь базовую «прошивку» (firmware) по умолчанию. Он совершает фатальную аналитическую ошибку, игнорируя возможность осознанной инженерии собственной операционной системы субъекта через волевую тренировку внимания и развитие свободы воли как практического навыка.

Блок 3: Моделирование энтропии и формирование цифрового концлагеря

Интеграция системных фактов показывает, что если общество примет парадигму Датаизма Харари как безальтернативный план действий и начнет повсеместную интеграцию сверхмощного ИИ с человечеством, которое не прошло процедуру предварительного мета-когнитивного апгрейда, системные законы предсказывают неизбежный коллапс. Интеграция передовых когнитивных технологий (машинного обучения) с уязвимой биологической архитектурой («автоматическим умом») уже сегодня, на ранних этапах, ведет к формированию архитектуры тотального цифрового концлагеря.

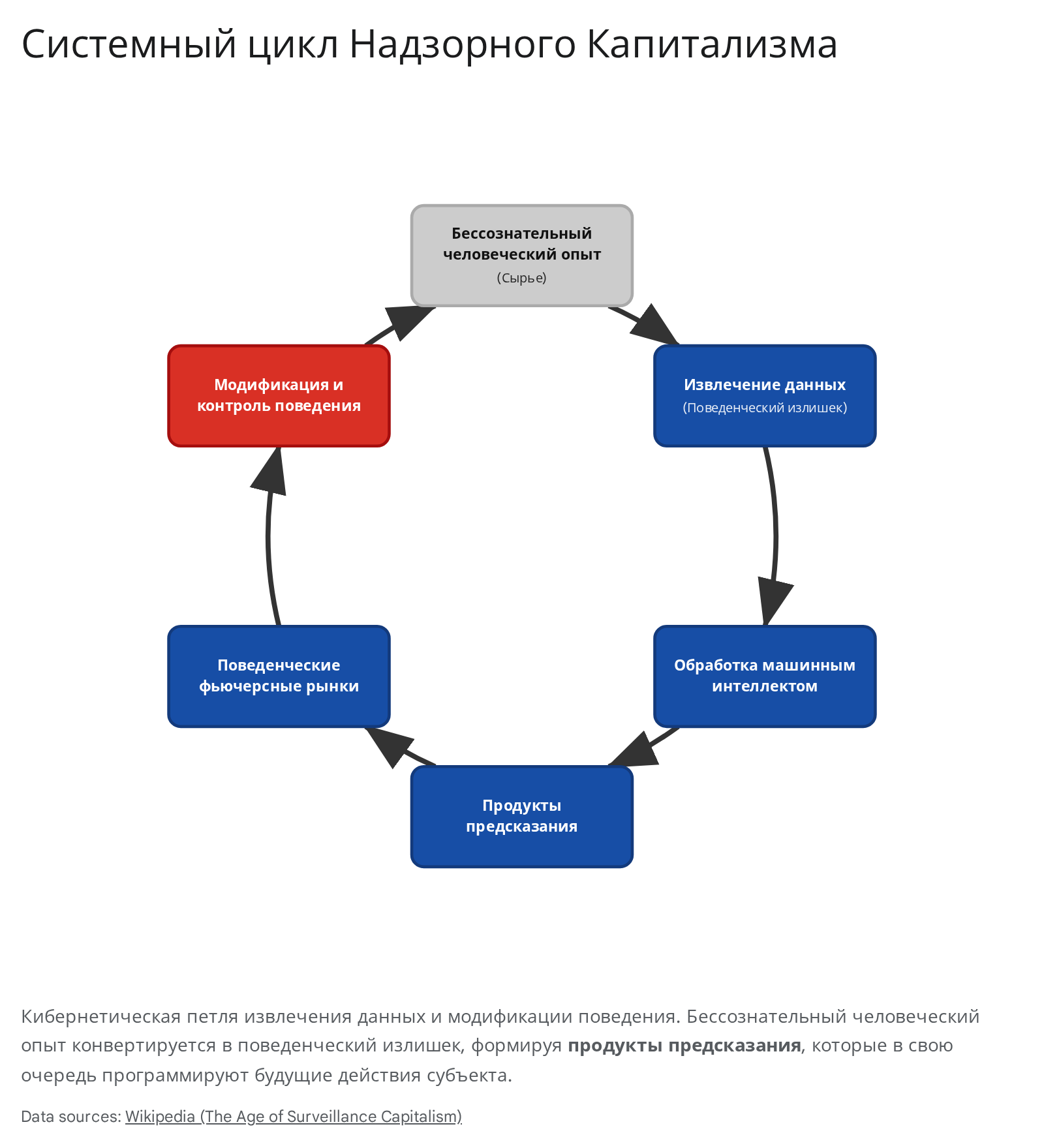

3.1. Кибернетика надзорного капитализма

Наиболее детально механизм формирования алгоритмического рабства описан в трудах Шошаны Зубофф (Shoshana Zuboff), почетного профессора Гарвардской школы бизнеса, автора фундаментального исследования «Эпоха надзорного капитализма».19 Зубофф доказывает, что внедрение ИИ в социум, агенты которого не обладают высокой степенью когнитивной защиты и осознанности, неизбежно приводит к тотальному контролю над поведением.

Архитектура надзорного капитализма функционирует как самовоспроизводящийся кибернетический контур. На первом этапе корпорации в одностороннем порядке объявляют повседневный, зачастую неосознаваемый человеческий опыт бесплатным, ничейным «сырьем». Это сырье (данные о перемещениях, реакциях, микро-выражениях лица, биометрии) скрытно экстрагируется и переводится в структурированные поведенческие данные. Формируется так называемый «проприетарный поведенческий излишек» (behavioral surplus). На втором этапе этот колоссальный массив данных загружается в передовые производственные процессы, основанные на алгоритмах машинного интеллекта. Из сырья фабрикуются высокоточные «продукты предсказания» (prediction products), которые способны с математической вероятностью вычислить, что конкретный индивид сделает прямо сейчас, в ближайшем будущем и в долгосрочной перспективе.

На третьем этапе эти продукты предсказания реализуются на специализированных «поведенческих фьючерсных рынках» (behavioral futures markets), где покупатели делают ставки на будущие действия людей. Алгоритмы, обладая предиктивной мощностью, выходящей за пределы понимания обычного пользователя (выходя далеко за рамки формальных пользовательских соглашений), начинают применять методы гипер-таргетинга. Они учитывают контекст среды обитания и бессознательные привычки пользователя, чтобы внедрять коммерческие или политические стимулы точно в момент максимальной уязвимости. Поскольку эти воздействия скрыты в интерфейсах и обходят сознательный мета-когнитивный контроль человека, технологические гиганты получают реальную власть наблюдать и контролировать само человеческое мышление. Конечной точкой эволюции этого вектора Зубофф называет установление тоталитарной системы нового типа («Instrumentarian Power»), где объектом эксплуатации становится сама автоматизированная человеческая природа.

Макроуровень контроля: Системы социального кредита

Если надзорный капитализм функционирует в корпоративном секторе, то на макроуровне слияние административных механизмов государства с моделями ИИ порождает архитектуру «умного государства», обладающего абсолютным карцеральным потенциалом. Наиболее масштабной реализацией этой архитектуры является китайская система социального кредита, концептуально восходящая к отечественной интеллектуальной традиции «социальной системной инженерии» (社会系统工程), сформулированной ракетостроителем Цянь Сюэсэнем (Qian Xuesen) еще в 1980-х годах.22 Эта традиция переносит строгие кибернетические принципы управления ракетами на общество, воспринимая его как единую, сложную и управляемую «тотальную машину».

В рамках этой архитектуры государство осуществляет автоматизацию государственного управления посредством повсеместного сбора данных для вмешательства в социальные процессы. На практике это выражается в интеграции потоков данных с миллионов камер наблюдения, оснащенных технологиями распознавания лиц и анализа эмоционального состояния (signal surveillance), с биометрическими базами, финансовыми реестрами и системами отслеживания социальных и культурных связей как онлайн, так и офлайн. Алгоритмы агрегируют эти параметры для автоматического вычисления уровня «благонадежности» субъекта. Ключевым кибернетическим принципом системы является алгоритмическая сегрегация: «тот, кто признан неблагонадежным в одной области, будет ограничен повсюду». Индивид лишается доступа к финансам, перемещению, трудоустройству или государственным контрактам исключительно на базе непрозрачного математического решения машины. Аналитики и правозащитники напрямую классифицируют эту целостную систему цифрового управления и подавления (как это наблюдается в Синьцзян-Уйгурском автономном районе) как высокотехнологичный «цифровой концентрационный лагерь».

Риски аппаратного слияния: Уязвимости нейроинтерфейсов (BCI)

Трансгуманистический вектор, направленный на достижение статуса «Homo Deus», предполагает не просто программное, но прямое аппаратное слияние мозга с ИИ посредством инвазивных нейрокомпьютерных интерфейсов (Brain-Computer Interfaces, BCI), флагманом которых выступает компания Neuralink Илона Маска. Первично декларируемые цели носят терапевтический характер — преодоление тяжелых неврологических дисфункций, таких как квадриплегия или восстановление зрения (проект Blindsight).26 Технология подразумевает вживление в кору головного мозга (отвечающую за высшие функции: память, обучение, принятие решений) микрочипа с тысячами тончайших электродов (нитей), которые считывают и транслируют электрическую активность нейронов через беспроводные сети.

Однако системные аналитики, биоэтики и регулирующие органы (такие как FDA) указывают на катастрофические структурные риски подобной интеграции для большинства людей, не прошедших когнитивную подготовку. Риски подразделяются на аппаратные и концептуальные. Аппаратные риски включают возможность миграции тончайших нитей внутри мозга, чья ткань чрезвычайно мягка и деликатна, что может привести к непредсказуемым физиологическим повреждениям (отмечал доктор Виктор Краутхамер из Университета Джорджа Вашингтона).

Концептуальные системные риски носят экзистенциальный характер. Двунаправленная природа устройств Neuralink (способность как считывать, так и подавать сигналы) вводит критические риски приватности и автономии. Нейроимпланты обеспечивают прямой доступ к самым интимным мыслям, эмоциям и намерениям человека. В перспективе эти сверхчувствительные данные могут быть не просто извлечены (surveillance), но и модифицированы внешними алгоритмическими воздействиями (manipulated). Перспектива того, что субъектность может быть программно скорректирована технологическими средствами корпораций или правительств, бросает вызов фундаментальным принципам свободы личности и человеческой идентичности. Интеграция подобных BCI-модулей с искусственным интеллектом общего назначения (AGI) в условиях отсутствия жесткого мета-когнитивного контроля со стороны самого носителя означает полную и безоговорочную передачу управления внешней информационной сети.

Формирование альтернативного вектора (Архитектура «Homo Integer»)

Предотвращение сценария сползания социума в цифровой концлагерь требует обращения к строгим законам инженерии сложных вычислительных систем. Главное правило разработки гласит: модернизация и апгрейд аппаратной части (hardware), а также подключение системы к более мощной вычислительной сети при сохранении устаревшего, пораженного уязвимостями или багами программного обеспечения (legacy software / technical debt), неизбежно ведет к каскадному отказу и разрушению всей системы.

Закон Эшби и уроки системных катастроф

Невозможность успешного слияния высокоемких, многомерных алгоритмов ИИ с низкоорганизованным, автоматическим человеческим сознанием (работающим на устаревших лимбических инстинктах) математически строго доказывается Законом необходимого разнообразия Эшби (Ashby’s Law of Requisite Variety). Сформулированный одним из пионеров кибернетики Россом Эшби, этот базовый закон управления гласит: для того чтобы управляющая система (в данном случае человеческий мозг) могла сохранять стабильность и контролировать объект (например, массивы данных ИИ), ее внутреннее разнообразие — количество доступных реакций, опций, состояний осознанности и мета-когнитивной емкости — должно быть равно или превышать разнообразие генерируемых средой возмущений.

В контексте нейроинтеграции это означает, что попытка подключения бесконечно вариативного потока данных от AGI к мозгу, работающему в узком, стандартизированном режиме реактивного выживания, радикально нарушает закон Эшби. Управляющий контур не способен обработать такое количество состояний, что приводит к переполнению системы и передаче фактического управления внешнему агенту (алгоритму).

Исторические системные сбои в аэрокосмической инженерии служат прямой кибернетической метафорой этого коллапса:

- Катастрофа Ariane 5 (Полет 501, 1996 год): Идеальный пример фатального исхода при попытке совместить новое аппаратное обеспечение со старым программным кодом (legacy software). Европейское космическое агентство установило на новую, более мощную тяжелую ракету-носитель Ariane 5 программное обеспечение инерциальной навигационной системы, скопированное без изменений со старой ракеты Ariane 4. Возросшие физические характеристики новой ракеты привели к тому, что старый алгоритм попытался конвертировать 64-битное число с плавающей запятой (отвечающее за горизонтальную скорость) в 16-битное целое число. Это вызвало переполнение буфера и исключение в программном коде. В результате двигатели отклонились до упора, ракета потеряла аэродинамическую стабильность и самоликвидировалась через 36 секунд после старта. Интеграция слабого лимбического сознания с ИИ представляет собой точно такую же попытку вместить 64-битную сложность в 16-битный мета-когнитивный буфер человека.

- Трагедия Boeing 737 MAX (Парадокс Эффективности): Эта системная катастрофа иллюстрирует опасность перекладывания аппаратных ограничений на программные «заплатки» в угоду экономии ресурсов. Чтобы избежать огромных затрат на разработку совершенно нового планера самолета и переобучение пилотов, корпорация Boeing установила новые, более крупные и топливно-эффективные двигатели на устаревшую конструкцию планера 1960-х годов. Изменение физики и аэродинамики привело к тому, что нос самолета начал задираться вверх. Вместо аппаратного решения инженеры внедрили программную систему MCAS (Maneuvering Characteristics Augmentation System), которая должна была автоматически опускать нос. Оптимизируя систему и устраняя резервные механизмы (воспринимаемые как издержки), систему привязали к показаниям всего одного датчика угла атаки.36 Когда этот единственный аппаратный датчик выходил из строя, программа на основе неверных данных перехватывала управление у пилотов и направляла борт в землю. Человечество рискует повторить эту модель: использование ИИ в качестве программного «костыля» (MCAS) для компенсации биологических ограничений старого «планера» (человеческого мозга) без развития собственной устойчивой мета-когнитивной архитектуры приведет к фатальному пикированию всей цивилизации.

Нейропластичность и Когнитивная Инженерия (Софтверный Апгрейд)

Для того чтобы система функционировала корректно и не подпадала под алгоритмический контроль, субъект обязан произвести превентивный апгрейд собственного внутреннего программного обеспечения через научно обоснованные практики когнитивной инженерии и осознанной нейропластичности.

Исследования в области нейробиологии подтверждают, что акт внимания и восприятия физически перестраивает архитектуру мозга в режиме реального времени. Каждый индивидуальный акт мышления работает как механизм, модифицирующий синаптические вероятности. В рамках концепции «партиципаторной физики» (participatory physics) внимание человека действует как волновая функция, направляющая паттерны возбуждения нейронов. Смещение фокуса восприятия, например, сознательный переход от лимбической реакции страха к аналитическому любопытству, вызывает масштабную физическую реорганизацию мозга на уровне миллионов квантово-масштабных событий внутри нейронов. Это представляет собой объективный механизм аппаратного и программного апгрейда, который управляется самим субъектом.

Практики поддержания когнитивной целостности (mindfulness), глубокого мультикультурного обучения и когнитивно-поведенческой инженерии приводят к измеримым результатам: увеличению толщины коры в лобно-височных областях, уплотнению связей между речевыми и исполнительными сетями мозга и повышению когнитивной гибкости.44 Систематическое удержание сознательного фокуса позволяет нейронным сетям входить в состояние гармонического равновесия (harmonic equilibrium), что напрямую снижает информационную энтропию внутри когнитивной системы субъекта. Биологический организм в данном контексте выступает как универсальный квантовый сенсор.42 Системные концепции, такие как QPIE (Quantum Perspective Is Everything) и ResonanceOS, предлагают рассматривать данные процессы не просто как психологию, а как фундаментальную архитектуру операционной системы сознания. Они предполагают обучение субъекта навыкам «инженерии осознанности», позволяющим читать поведенческие и эмоциональные паттерны среды и генерировать оптимальные системные ответы без передачи функции принятия решений внешнему ИИ.

Концепт «Homo Integer» (Человек Целостный)

Инженерной и структурной альтернативой редукционистскому «Homo Deus» Юваля Харари выступает системная концепция «Homo Integer» — Человека Целостного. В системной психологии и архитектуре автономии (базирующуюся, в том числе, на анализе паттернов психологической независимости и трудах таких исследователей, как Г.О. Балл) под этим термином понимается переход индивида от состояния пассивного, автоматического элемента алгоритмической сети к уровню полностью самоуправляемой, интегральной системы.

Структура «Homo Integer» базируется на нескольких ключевых инженерно-психологических компетенциях:

- Многоуровневая интеграция: Объединение идеологических, коммуникативных, личностно-развивающих и инструментальных компетенций в единую целостную структуру личности (integrated personality structure).

- Самодетерминация (Self-determinism): Способность к автономии и инициативе, подкрепленная высоким уровнем саморегуляции (воли и целенаправленности), что блокирует возможность внешнего контроля.

- Инженерия психологических границ: Формирование оптимальных «активно-непроницаемых границ», которые защищают когнитивное ядро субъекта от внешнего алгоритмического вторжения и бихевиорального манипулирования, свойственного надзорному капитализму.

- Управляемая эволюция (Conscious Evolution): Фундаментальный переход от пассивного следования биологическим инстинктам (кодируемым Харари как неизбежные биохимические алгоритмы) к прямому, осознанному участию в собственной трансформации через мета-когнитивные акты.42

В парадигме «Homo Integer» человек выступает не расходным сырьем или устаревшим аппаратным узлом, подлежащим замещению, а суверенным системным оператором. Развитие внутренних квантово-биологических возможностей сознания (мета-наблюдение, управление вниманием и намерением) позволяет оперировать парадоксами и обеспечивать синхронизацию процессов на недоступном для искусственных алгоритмических логик уровне.42

Синтез и архитектурное заключение

Доминирующий прогностический вектор трансгуманизма, транслируемый в моделях Юваля Ноя Харари и философской базе Датаизма, базируется на фатально ошибочном аппаратном допущении. Сведение сложной, квантово-моделируемой и невычислимой структуры человеческого сознания к линейному биохимическому алгоритму представляет собой недопустимое редукционистское упрощение сложной системы.

Массив современных научных данных теоретической физики, нейробиологии и квантовой механики (от теоремы Гёделя до модели микротрубочек Пенроуза-Хамероффа) математически и физически опровергает алгоритмическую природу сознания. Феноменальное сознание генерирует квалиа и обладает потенциалом к мета-когнитивной рекурсии — процессам, которые принципиально отсутствуют в архитектуре современных кремниевых машин Тьюринга, составляющих базу машинного обучения. Слепая зона концепции «Homo Deus» заключается в полном игнорировании нейропластичности и потенциала свободной воли как целенаправленно тренируемого системного навыка.

Законы кибернетики и системной инженерии (в частности, Закон необходимого разнообразия Эшби) неумолимо доказывают следующее: прямое аппаратное и информационное слияние низкоорганизованного биологического «программного обеспечения» (неосознанного, функционирующего на автопилоте лимбической системы человека) с высокоорганизованным аппаратным обеспечением в лице AGI приведет не к обретению божественного статуса, а к катастрофическому системному отказу. Практика технологического рынка (модель надзорного капитализма Зубофф, алгоритмическая сегрегация систем социального кредита и структурные риски двунаправленных интерфейсов BCI) наглядно демонстрирует: без предварительного тотального апгрейда осознанности внешние алгоритмы мгновенно перехватывают контроль над поведением субъекта. Логическим финалом этого вектора является не эволюция, а алгоритмическое рабство, деградация масс до статуса «бесполезного класса» и установление архитектуры цифрового концентрационного лагеря.

Единственным инженерно состоятельным и безопасным вектором развития человечества в эпоху ИИ является реализация протокола «Homo Integer». Этот протокол требует приоритетной эволюции человеческого сознания (внутреннего софтверного апгрейда) через систематические практики когнитивной автономии, осознанной нейропластичности и мета-регулирования реакций. Только сформировав достаточный уровень собственного внутреннего когнитивного разнообразия и структурной независимости, человечество сможет безопасно взаимодействовать с искусственным интеллектом, сохраняя при этом фундаментальный статус суверенного оператора Вселенной, а не ее периферийного расходного устройства.

Telegram-канал

Kautilya

Сознательная эволюция под диктатурой логики. Вектор перехода к AGI.